Trash-talk oder Smack-talk ist eine höchst strategische Form der Beleidigung, gerne eingesetzt vor allem im Sport: Durch erniedrigende Bemerkungen versucht man den Gegner zu provozieren und ihn aus dem Konzept zu bringen, um sich damit einen Vorteil zu verschaffen. Ein Experiment von Forschern der Carnegie Mellon University in Pittsburgh hat nicht nur einmal mehr gezeigt, dass diese Strategie aufgeht – es braucht dafür offenbar nicht einmal einen menschlichen Provokateur.

Das Experiment

Für seine Versuchsreihe ließ das Team um Studienerstautor Aaron M. Roth 40 Probanden für ein wirtschaftliches Strategiespiel antreten. Es handelte sich dabei um ein sogenanntes Stackelberg-Spiel, in dem "Leader" und "Follower" miteinander konkurrieren. Mit dieser Variante von Spielen überprüfen Forscher gerne, wie rational ihre Testpersonen vorgehen.

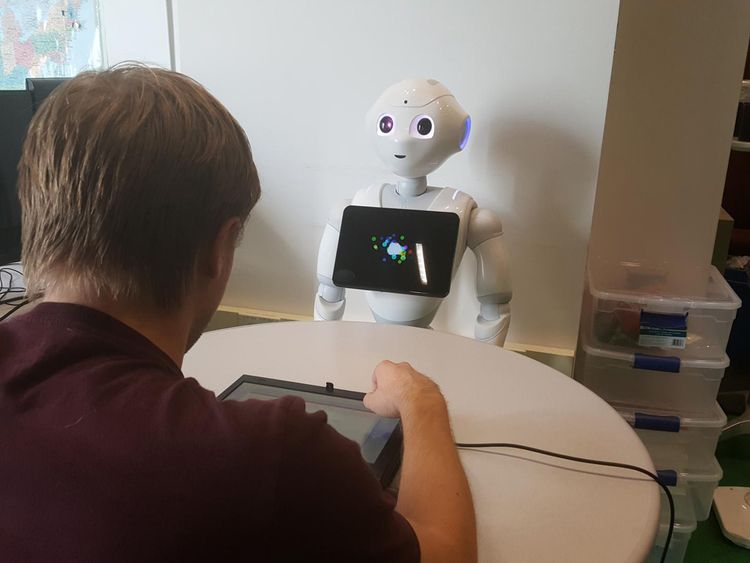

Die Besonderheit in diesem Fall: Dem menschlichen Spieler saß ein semi-humanoid geformter Roboter des kommerziell vertriebenen Typs Pepper gegenüber. Der deckte den Spieler dann entweder mit lobenden Worten oder mit Trash-talk ein. Keinem übrigens, von dem man rote Ohren bekommen würde, es waren nur kleine Sticheleien wie: "Ich muss schon sagen, du bist ein furchtbarer Spieler" oder "Im Lauf des Spiels sind deine Züge verwirrt geworden".

Eindeutige Resultate

Und obwohl das "Beschimpfungen" der sanfteren Art waren, zeigten sie eindeutig Wirkung. Die Spieler hatten jeweils 35 Runden zu absolvieren, und alle gingen zwar von Mal zu Mal rationaler vor. Die eingespielten Resultate waren aber nicht gleich: Diejenigen, die Trash-talk ausgesetzt gewesen waren, fuhren im Schnitt signifikant schlechtere Ergebnisse als diejenigen ein, die gelobt worden waren.

Daran änderte auch der Umstand nichts, dass den meisten Probanden sehr bewusst war, dass sie es nur mit einer Maschine zu tun hatten, die einprogrammierte Sätze abspulte, und nicht mit einem selbstständigen "bösen" Verstand. Roth zitierte einen seiner Probanden: "Ich mag nicht, was der Roboter sagt, aber so ist er programmiert worden, also kann ich ihm keine Schuld geben." Eine sehr rationale Einstellung, die aber offenbar auch nicht ausreicht, sich gegen robotische Beleidigungen komplett zu wappnen.

Blick in die Zukunft

Auf den allgemeinen psychologischen Kontext von Lob und Schimpf sind die Forscher nicht näher eingegangen, sie fokussierten auf etwas anderes, wie Roths Kollegin Fei Fang betont: "Dies ist eine der ersten Studien über Mensch-Roboter-Interaktionen in einer Umgebung, in der diese nicht kooperieren." Bisher hätten Roboter-Studien vor allem die Möglichkeiten einer harmonischen Zusammenarbeit untersucht. Angesichts einer Zukunft, in der künstliche Intelligenzen "in exponentiellem Wachstum" zum Einsatz kommen werden, müsse man aber auch negative Interaktionen in Betracht ziehen – Trash-talk steht da nur stellvertretend für alle möglichen Psycho-Tricks.

Bei intelligenten persönlichen Assistenten, wie sie etwa im Eigenheim zum Einsatz kommen, dürfe man davon ausgehen, dass sie sich kooperativ verhalten, so Fang. Anders könnte das beispielsweise beim Online-Shopping aussehen – immerhin gehen da die Interessen des Käufers und desjenigen, der ihm eine virtuelle "Hilfe" bereitstellt, nicht unbedingt immer konform. (jdo, 1.1.2020)