Smarte Technologien wie Sprachassistenten oder intelligente Heizungssysteme erobern zunehmend unseren Alltag. Die Politikwissenschafterin Leonie Tanczer erforscht, welche Rolle dieses "Internet der Dinge" in Fällen häuslicher Gewalt spielt. Das Missbrauchspotenzial neuer Technologien müsse schon in der Entwicklung mitgedacht werden, fordert die Internetforscherin.

STANDARD: Während des Corona-Lockdowns wurde vielerorts ein Anstieg häuslicher Gewalt verzeichnet. Gilt das auch für Gewalt in Zusammenhang mit digitalen Technologien?

Tanczer: Absolut. Wir sahen einen Anstieg der Verbreitung von intimen Bildern von Personen ohne deren Einwilligung. Dieses Phänomen wird häufig als "Racheporno" bezeichnet – wobei ich diesen Begriff äußerst problematisch finde, weil er den Fokus auf die Betroffenen statt auf die Täter und Täterinnen richtet. Des Weiteren wurden sogenannte Stalkerware oder Spyware-Apps – sprich Spionagesoftware – verwendet. Die vermehrte Nutzung des Internets und sozialer Medien während des Lockdowns bietet eine mögliche Erklärung dafür.

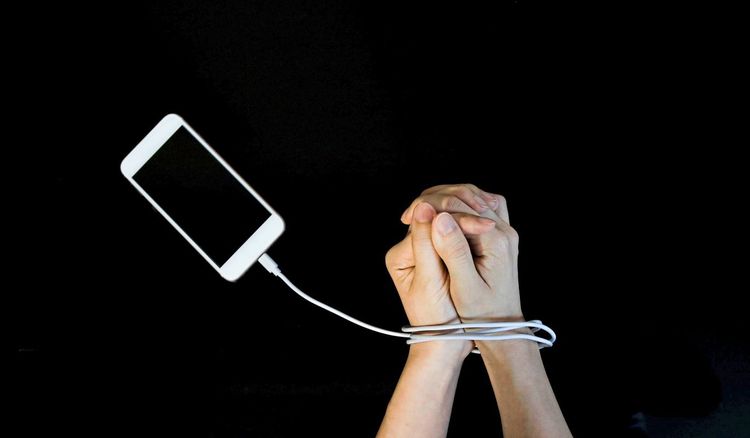

STANDARD: Belästigung über das Internet wie das Versenden von unerwünschten Nachrichten oder Penisbildern ist ein seit vielen Jahren bekanntes Phänomen. Wie setzen Täter und Täterinnen das Internet der Dinge ein, um Gewalt in Beziehungen auszuüben?

Tanczer: Ein großes Problem ist, dass sich die Funktionalität dieser Geräte sehr gut für Spionage eignet. Das Internet der Dinge ist darauf aufgebaut, dass sich alle Menschen in einem Haushalt vertrauen und auch zugestimmt haben, dass Daten aufgezeichnet werden. In einer Gewaltbeziehung ist das jedoch nicht wirklich möglich. Vielmehr hat eine Person die Kontrolle – sowohl über die andere Person als auch über die verwendeten technischen Systeme. Diese werden deshalb gezielt missbraucht. Smart-TVs sind schon länger in vielen Haushalten zu finden. Relativ neu sind hingegen smarte Licht- und Heizungssysteme. Das hört sich jetzt vielleicht banal an, aber die Steuerung solcher Systeme ohne das Einverständnis von Betroffenen kann große Verunsicherung hervorrufen. Oft wissen sie gar nicht, wer Zugriff auf welche Konten und Geräte hat und was genau abläuft und geschieht. Auch über Geräte wie Smartspeakers lassen sich Daten ausspionieren. Betroffene haben uns berichtet, dass Ex-Partner und Ex-Partnerinnen sie nutzten, um Musik abzuspielen, die in der Beziehung von Bedeutung war.

STANDARD: Lässt sich das Phänomen beziffern? Wie verbreitet ist diese Form des Missbrauchs von Technologie?

Tanczer: Speziell zum Internet der Dinge gibt es noch keine Zahlen. Die Forschung gestaltet sich hier schwierig. Frauenhäuser oder Organisationen, die mit Täter und Täterinnen arbeiten, führen keine Statistik zu digitaler Gewalt. Allein dieser Begriff ist ein riesiger Koffer, den wir erst aufmachen und im Detail untersuchen müssen. Wir bauen daher vermehrt auf Partnerschaften mit der Polizei und anderen Einrichtungen, um Daten zu sammeln.

STANDARD: Geräte wie Amazon Echo werden von Datenschützern und Datenschützerinnen massiv kritisiert. Dennoch setzen sich viele Nutzer und Nutzerinnen aus Bequemlichkeit nicht mit den Funktionalitäten auseinander. Ist das eine Gefahr?

Tanczer: Wir befinden uns aktuell in einer Situation, in der die Überschätzung der Funktionalität von smarten Systemen genauso gefährlich ist wie deren Unterschätzung. Täter und Täterinnen nutzen diese Unsicherheit gezielt aus. Eine fundamentale Frage ist immer, wer ein Gerät kontrolliert. Sprich: Wer hat es gekauft? Wer hat es aufgesetzt? Wer bezahlt für den Service? Und wer weiß das Passwort? Viele Frauen vergessen zum Beispiel, dass ihr Handy vom Partner erworben wurde und er auch nach einer Trennung die Rechnung weiterhin bezahlt. Darüber kann er wiederum Daten einsehen. Aus unserer Forschung wissen wir jedoch auch, dass Frauen, die aus einer Gewaltbeziehung geflüchtet sind, Technologien gezielt nutzen, um sich selbst ein Stück Sicherheit zu schaffen. Kameras, die mit dem Internet verbunden sind, oder digitale Türklingeln geben ihnen das Gefühl, den Überblick zu bewahren.

STANDARD: Mittlerweile sind zahlreiche Produkte am Markt, die vor Gewalt schützen sollen. Eine französische Organisation verkauft etwa ein Armband, das via Bluetooth mit einer App (Elles) kommuniziert – und rasch Notfallkontakte alarmiert.

Tanczer: Wir sehen eine ganze Bandbreite dieser Geräte und Systeme. Hier in Großbritannien ist die App Hollie Guard verbreitet. Sie ermöglicht es, Audio- und Videoaufnahmen als Beweismaterial zu erstellen und rasch und einfach jemanden zu kontaktieren. Für "high-risk victims", also Betroffene, die zum Beispiel vom Ex-Partner massiv bedroht sind, können solche Technologien durchaus ein Sicherheitsgefühl schaffen. Problematisch wird es aber, wenn der Vorwurf aufkommt: Warum hast du das nicht getragen oder verwendet? Wenn also die Betroffenen plötzlich in der Verantwortung stehen, sich selbst zu schützen. Das ist eine neue Form des Victim-Blamings. Für mich stehen viel zu oft die Betroffenen im Fokus, wenn Vertreter*innen der Tech-Konzerne nach Lösungen suchen. Man erwartet, dass Frauen ein Produkt kaufen, etwas erlernen, aktiv werden, oder sich und ihr Verhalten ändern sollen. Die Frage sollte viel eher sein: Wie können wir Technologien gestalten, die es Täter*innen nicht erlauben, bestimmte Dinge zu tun?

STANDARD: Die Idee, dass auch Technologie ein Geschlecht hat, scheint im Mainstream angekommen zu sein. In ihrem Buch "Unsichtbare Frauen" schildert etwa Caroline Criado-Perez, wie eine von Daten beherrschte Welt Frauen ausblendet und somit auch diskriminiert – und landete damit einen Bestseller. Hat sich diese Erkenntnis auch im Silicon Valley durchgesetzt?

Tanczer: IBM hat in dieser Hinsicht vor kurzem einen großen Sprung gemacht. Das Unternehmen hat Richtlinien erstellt, auf deren Basis künftige Entwicklungen überprüft werden sollen, ob sie für häusliche Gewalt missbraucht werden können. Es ist schade, dass es so lange gedauert hat, bis sich zu diesem Thema etwas tut. Aber ich hoffe, dass andere Unternehmen nachziehen werden. Technik ist nach wie vor ganz klar gegendert. Aber auf Techkonferenzen wird man auch weiterhin Leute treffen, die meinen, Algorithmen hätten kein Stereotypenproblem oder dass die Verantwortung, sich zu schützen, bei Nutzern und Nutzerinnen liegt. Überhaupt hatten Entwickler und Entwicklerinnen lange Zeit nur externe Bedrohungen im Blick. Sprich: Kriminelle, Terroristen und Terroristinnen oder Staatsakteure. Die Gefahr befindet sich aber oft im eigenen Haushalt. Es ist enorm wichtig, dass wir diese Erkenntnis verbreiten.

STANDARD: Können wir darauf vertrauen, dass auch Konzerne ein Interesse haben, in die Sicherheit ihrer Technologien zu investieren? Im Umgang mit Problemen wie Online-Harassment haben sich Google und Co als äußerst träge erwiesen.

Tanczer: Ich glaube, es gibt hier mehrere Wege und Optionen. Zum einen sollten Unternehmen wie Google oder Amazon dem Beispiel von IBM folgen. Natürlich sind das riesige Tanker, die schwierig zu lenken sind. Aber die Industrie könnte hier definitiv selbst aktiv werden. Die andere Möglichkeit wäre, das Thema politisch zu regulieren. Ohne Frage, auch das ist schwierig. Wenn etwa Österreich versucht, hier Gesetze zu schaffen, wird das nichts bringen. Wir befinden uns auf einem europäischen Markt, das muss auf internationaler Ebene passieren. Ein Missbrauch von Technologien kann nie vollständig verhindern werden. Nichtsdestoweniger muss es uns allen ein Anliegen sein, dass es Tätern und Täterinnen so schwierig wie möglich gemacht wird, Systeme zu instrumentalisieren. Klar ist nämlich, dass die Industrie darauf setzt, dass irgendwann alle Geräte miteinander vernetzt sind – vom Toaster bis zum Türschloss. Und ob uns das gefällt oder nicht – diese Technologien sind gekommen, um zu bleiben. (Brigitte Theißl, 30.8.2020)