Die Suchmaschine war nicht nur das erste Produkt von Google, es bleibt bis heute auch eines der erfolgreichsten. Bei einem aktuellen Marktanteil von mehr als 93 Prozent scheint es fast schon untertrieben, die Position der Google-Suche in Europa als "dominant" zu bezeichnen. Zumal dieser Wert über die Jahre praktisch unverändert geblieben ist. Weder lauter werdende öffentliche Kritik noch erste Regulierungsversuche konnten daran etwas ändern. Bei Google würde man dazu sagen, dass dies schlicht daran liegt, dass man einfach auch ein sehr gutes Produkt liefert. Ob hier nicht andere Faktoren ebenfalls eine Rolle spielen, sei dahingestellt, klar ist aber: Google investiert weiterhin offensiv in Innovationen rund um die Google-Suche. Im Rahmen eines "Search On" genannten Live-Events konnte das Unternehmen denn auch mit einigen Neuankündigungen aufwarten.

MUM übernimmt

Wer die Produktankündigungen von Google in den vergangenen Jahren auch nur am Rande verfolgt hat, weiß: Der Begriff "künstliche Intelligenz" spielt immer eine wichtige Rolle. Das ist bei Search On nicht anders, und der entscheidende Begriff ist in diesem Falle MUM. Das ist die Abkürzung für das sogenannte Multitask Unified Model, eines neuen Maschinenlernmodells, das Google zum ersten Mal vor einigen Monaten im Rahmen der Entwicklerkonferenz I/O vorgezeigt hatte. Zur Erinnerung: Dieses soll um ein Vielfaches mächtiger als bisher genutzte Modelle wie Googles eigenes BERT sein. Vor allem kann MUM gelerntes Wissen auf unterschiedliche Modalitäten – also Bilder, Texte, Videos – übertragen – daher rührt dann auch der Name. Ebenso unterstützt MUM von Haus aus bis zu 75 Sprachen, und kann generell Zusammenhänge zwischen unterschiedlichen Konzepten und Themen identifizieren. Klassische Maschinenlernmodelle funktionieren hingegen hochspezialisiert.

Google Lens

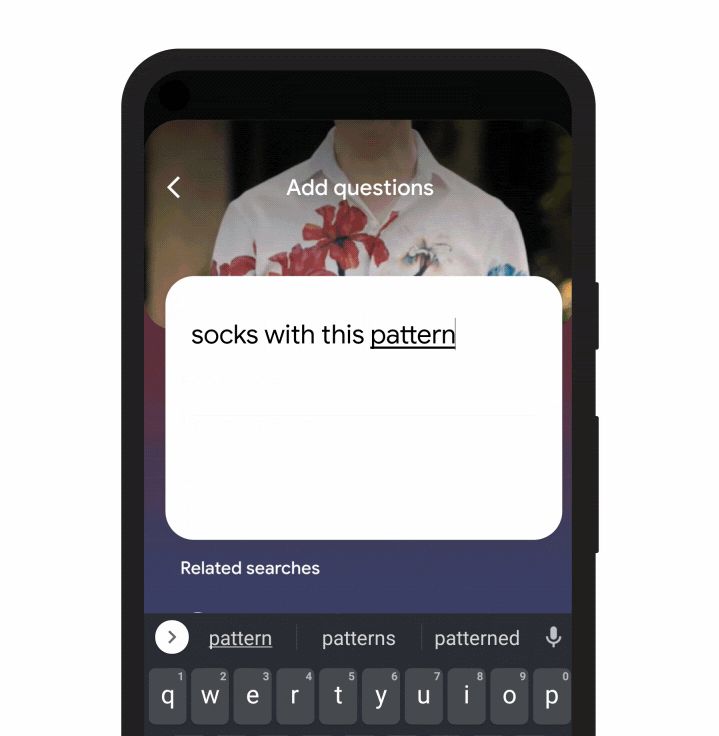

Passend zur Search On gibt es nun die ersten konkreten Einsatzbereiche von MUM, die dann auch zeigen, was all die Begriffe, mit denen in dem Zusammenhang herumgeworfen wird, in der Praxis bedeuten. Erstes Beispiel ist ein Update für die visuelle Suche Google Lens, das in den kommenden Monaten zunächst für englischsprachige Nutzer veröffentlicht werden soll. Dieses soll es ermöglichen, Bild- mit Textsuchen zu kombinieren. Konnte man schon bisher mit Lens ein Hemd fotografieren, um herauszufinden, wo man das entsprechende Stück – oder ein ähnliches – bekommen kann, ist es nun auch möglich, weiterführende Fragen zu stellen – etwa um andere Kleidungsstücke mit einem ähnlichen Muster zu finden.

Ein zweites Beispiel zeigt das Potential dieser Technologie noch besser. Künftig soll es möglich sein, ein Foto eines Objekts zu machen, um zu fragen: "Wie repariere ich das?" Den Namen des defekten Bestandteils muss man also gar nicht wissen. Genau das sei nämlich bei klassischen Suchen bisher ein nicht zu unterschätzendes Defizit, wie Google betont. Also das man oft gar nicht weiß, wie der richtige Begriff für etwas lautet, nach dem man sucht.

Suchmaschine

Doch MUM verspricht auch für die klassische Google-Suche Verbesserungen, oder wie es Google nennt: Ein grundlegendes Redesign der Suche für die Zukunft. So wird MUM künftig eingesetzt, um Videos zu analysieren – und zwar sowohl Ton als auch Bild –, um dann automatisch passende Themen und weiterführende Informationen zu deren Inhalten zu liefern. In einem ersten Schritt beschränkt man sich dabei auf Youtube-Videos, in Zukunft sollen aber auch Videos aus anderen Quellen analysiert werden. Nutzbar soll das Ganze schon innerhalb der nächsten Wochen sein, das aber vorerst nur auf Englisch.

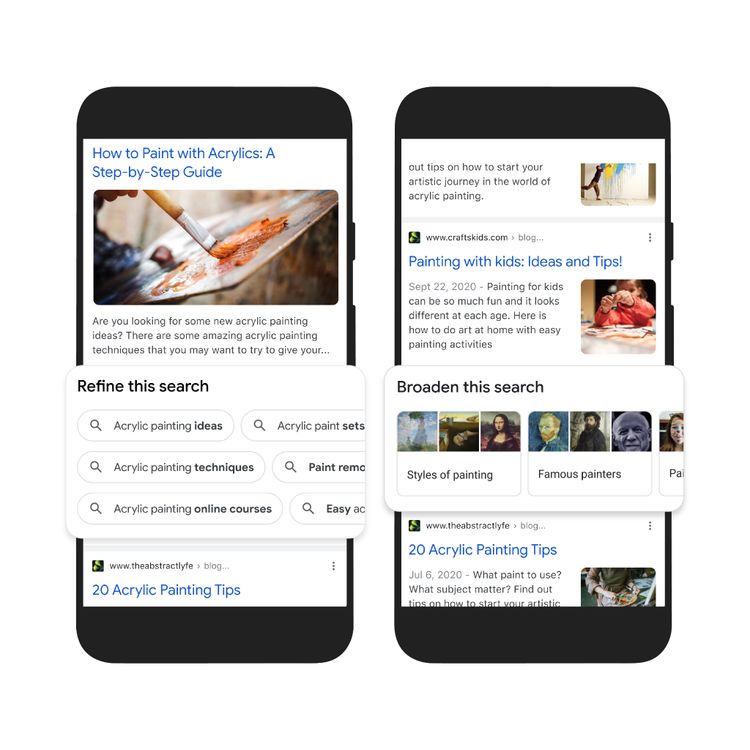

Auch sonst sollen künftig mehr Basisinfos direkt angezeigt werden, wenn nach grundlegenden Themen wie "Acrylmalerei" gefragt wird – "Things to know" nennt man dies. Das entsprechende Feature soll in den kommenden Monaten verfügbar sein, selbiges gilt für eine weitere Neuerung namens "Refine & Broaden" – also Verfeinern und Ausweiten. Dafür lernt die Google-Suche künftig besser die Verhältnisse zwischen einzelnen Begriffen, um dann dabei zu helfen, sowohl tiefer in ein Thema vordringen als auch die Suche verallgemeinern zu können. Für beides werden dann passende Vorschläge angezeigt. Ebenfalls neu sind die "visuellen Ideen": In Zukunft sollen jene Suchen, die eher allgemeine Recherchen sind – also nicht nur nach simplen Fakten fragen –, zunehmend mit einer Mischung aus Text und Bild beantwortet werden. Auch das wird in den kommenden Monaten verfügbar sein – zunächst aber nur in den USA.

Verantwortung

Doch noch einmal zurück zu MUM selbst. Zu den Grundgesetzen beim Maschinenlernen gehört es, dass nichts so wichtig ist wie das Trainingsmaterial, mit dem eine KI aufgebaut wird. In diesem Fall betont Google, dass die MUM-basierten Systeme zwar mit dem Open Web trainiert werden – aber nur mit einem Subset dessen, und zwar den Inhalten mit hoher Qualität. Damit soll verhindert werden, dass sich die KIs Falsches antrainieren. Darüber hinaus werden die Ergebnisse laufend überprüft und Korrekturen vorgenommen, wo es notwendig ist, verspricht Google. Immerhin gehe es darum, KI verantwortungsbewusst einzusetzen, anstatt Vorurteile und falsche Informationen zur reproduzieren.

Apropos: Auch bei der Google-Suche sieht man eine zentrale Herausforderung darin, Desinformationen zu bekämpfen. Dies tut man auf mehrere Weisen, etwa indem bei besonders sensiblen Themen – dazu gehören Gesundheitsinformationen – offizielle und vertrauensvolle Quellen gezielt bevorzugt werden. Zudem will man aber auch für die Nutzer die Transparenz erhöhen. Mit "About this result" gibt es schon seit ein paar Monaten – in den USA – weiterführende Details zu einzelnen Ergebnissen. Dies will man künftig weiter ausbauen, in dem etwa auch Details zu den publizierenden Webseiten angezeigt werden. Dazu gehört sowohl, was diese selbst über sich sagen, als auch wie andere diese sehen.

Lens in Chrome und auf iOS

Zu den weiteren Neuvorstellungen gehört die Integration von Google Lens direkt in den Browser Chrome. Damit können dann Texte, Bilder oder auch Videos ausgewählt und mit der visuellen Suche analysiert werden. Die Ergebnisse erscheinen dann direkt im selben Tab seitlich. Diese Neuerung soll in den kommenden Monaten weltweit für alle Nutzer zur Verfügung stehen – also weltweit. Das ist bei einer weiteren Neuerung anders, die vorerst einmal mehr nur für die USA gelauncht wird: Der "Lens Mode" soll künftig in der Google-App unter iOS sämtliche angezeigten Bilder via Google Lens analysieren.

Shopping

Eine Kategorie, die Google zuletzt deutlich forciert hat, ist die Shopping-Suche. Ab sofort soll es bei solchen Anfragen leichter werden, das Gewünschte über Kategorien und Stile einzugrenzen. Hinter all dem steht der neue Shopping Graph, der Echtzeitinformationen zu 24 Milliarden Einträgen liefern soll. Einmal mehr ist dieses Feature vorerst aber auf die USA beschränkt. Eine andere Shopping-Neuerung gibt es hingegen zumindest in ein paar weiteren Ländern – darunter auch Deutschland und die Schweiz: Lagerstandsinformationen direkt in der Produktsuche und zwar auch von kleineren Händlern. Eine Einschränkung bleibt dabei aber. Vorerst soll das Ganze nämlich nur mit englischen Spracheinstellungen gehen.

Maps

Ebenfalls auf künstliche Intelligenz setzt man rund um Google Maps. So soll es ab Oktober eine neue Darstellungsebene geben, auf der aktuelle Waldbrände angezeigt werden. Mit den "Tree Canopy Insights" analysiert man wiederum seit einiger Zeit den Baumbestand einzelner Städte, um bei der Verbesserung der Luftqualität und der Kühlung zu helfen. Diese Initiative ist zunächst in Los Angeles gestartet, und soll nun auf mehr als hundert weitere Städte ausgedehnt werden – darunter London, Sydney und Toronto.

Für viele Menschen in Mitteleuropa mag es kaum vorstellbar sein, aber es gibt weltweit zahlreiche Regionen, in denen Menschen keine Adresse haben, was allerlei Probleme erzeugt. Um dieses Problem anzugehen, unterstützt Google Maps schon länger die sogenannten Plus Codes. Das ist zwar nützlich, jeder Wohnung so einen Code zuzuordnen ist aber äußerst aufwendig. Dementsprechend kündigt Google nun ein zugehöriges – und kostenloses – Tool namens "Address Maker" an, das Regierungen und NGOs bei der Erstellung solcher Adressen behilflich sein soll. (Andreas Proschofsky, 29.09.2021)